Sam Altman craint un « Internet mort » : impact sur le SEO et solutions

Le CEO d'OpenAI alerte sur un Internet submergé par l'IA. Quelles conséquences pour votre visibilité et comment adapter votre stratégie SEO/GEO ?

Sam Altman, CEO d'OpenAI, a récemment exprimé une inquiétude qui devrait interpeller tout dirigeant d'entreprise : la « Dead Internet Theory » pourrait devenir réalité. Cette théorie, longtemps cantonnée aux forums conspirationnistes, prédit un Internet dominé par du contenu généré automatiquement, où les créations humaines authentiques deviendraient minoritaires, voire invisibles.

Pour les PME et ETI qui dépendent de leur visibilité en ligne, cette perspective n'est pas abstraite. Elle pose une question stratégique immédiate : comment se démarquer dans un océan de contenus synthétiques ? Comment les moteurs de recherche et les IA génératives distingueront-ils votre expertise réelle du bruit ambiant ?

Cet article analyse les implications concrètes de cette évolution pour votre stratégie SEO et GEO, et propose des solutions actionnables pour 2025 et au-delà.

La Dead Internet Theory : de la conspiration à la réalité opérationnelle

La Dead Internet Theory est née vers 2016 sur des forums comme 4chan. Sa thèse centrale : une proportion croissante du contenu en ligne serait générée par des bots, au point que les interactions humaines authentiques deviendraient rares. Pendant des années, cette idée a été considérée comme paranoïaque.

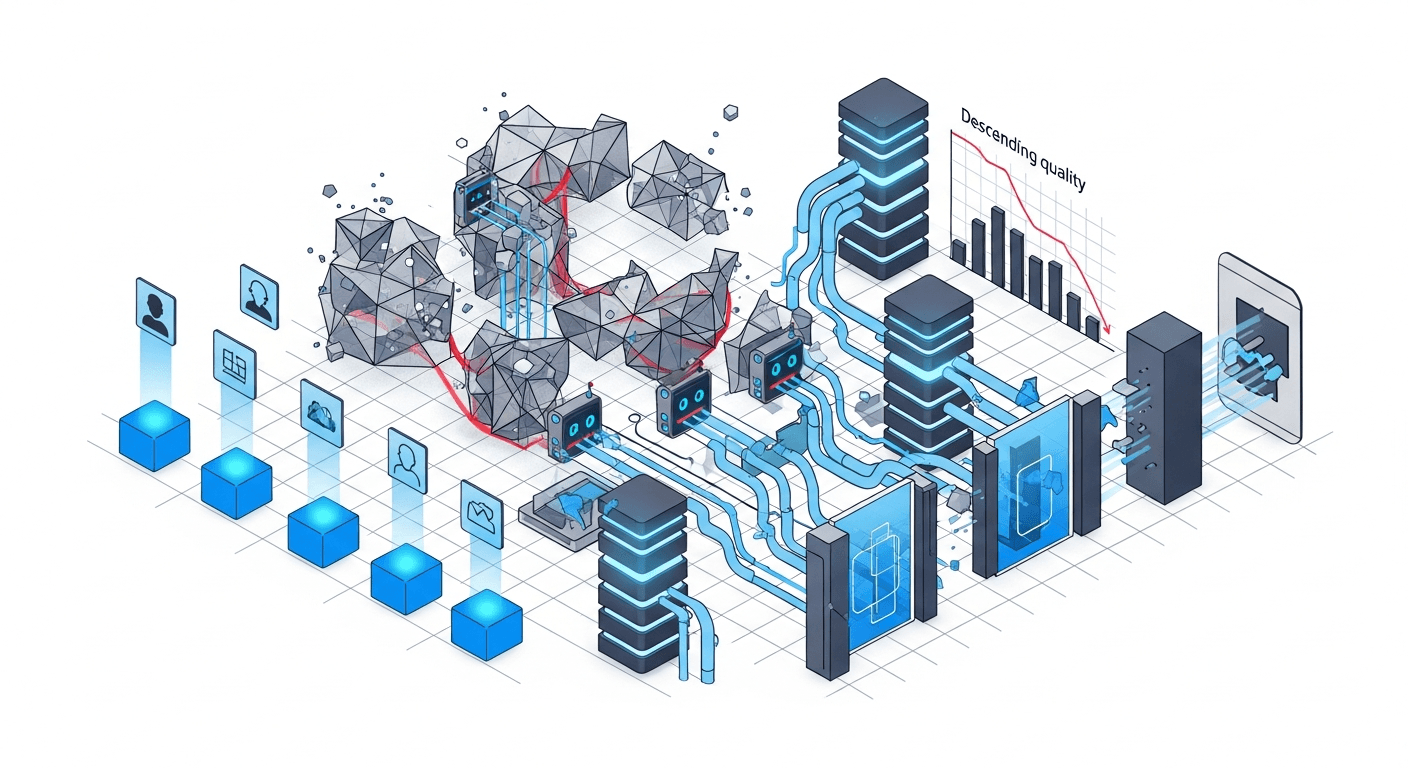

En 2025, les données racontent une autre histoire. Selon une étude d'Originality.ai, près de 57% des contenus web à forte visibilité présentent des marqueurs de génération par IA. Amazon a supprimé des milliers de livres générés automatiquement. Les réseaux sociaux luttent contre des fermes de bots de plus en plus sophistiquées.

Pourquoi Sam Altman tire la sonnette d'alarme

L'inquiétude du CEO d'OpenAI est paradoxale : il dirige l'entreprise qui a démocratisé les outils de génération de contenu. Mais Altman voit le problème systémique. Si ChatGPT et ses concurrents permettent de produire des millions d'articles, de commentaires et de posts chaque jour, la capacité des systèmes à identifier le contenu de valeur s'érode.

Altman a déclaré que la vitesse à laquelle l'IA peut générer du contenu dépasse désormais la capacité des plateformes à le filtrer. Pour les entreprises, cela signifie une chose : les stratégies de contenu basées sur le volume sont condamnées.

Les signaux visibles dès aujourd'hui

- Inflation des contenus indexés : Google indexe des milliards de nouvelles pages chaque mois, mais la proportion de contenus à valeur ajoutée diminue.

- Dégradation des SERPs : les résultats de recherche pour des requêtes commerciales sont de plus en plus pollués par des sites affiliés générés automatiquement.

- Méfiance croissante des utilisateurs : 63% des internautes français déclarent douter de l'authenticité des avis et contenus qu'ils consultent, selon une étude IFOP de 2024.

Impact direct sur le SEO traditionnel : les règles changent

Le SEO tel que pratiqué depuis 15 ans repose sur des principes que la pollution par l'IA remet en cause. Les moteurs de recherche adaptent leurs algorithmes, et ces adaptations ont des conséquences immédiates pour votre visibilité.

Google renforce la détection des contenus IA de faible valeur

La mise à jour « Helpful Content » de Google, renforcée en mars 2024, cible explicitement les sites dont le contenu semble produit principalement pour le référencement plutôt que pour les utilisateurs. Les signaux analysés incluent :

- L'homogénéité stylistique sur l'ensemble du site, typique des contenus générés

- L'absence de perspective unique ou d'expertise démontrable

- Le ratio entre contenu et signaux d'engagement réel

- La cohérence entre l'entité auteur et le sujet traité

Les sites touchés par cette mise à jour ont perdu en moyenne 40 à 80% de leur trafic organique. La récupération est longue et incertaine.

La fin du « contenu suffisant »

Pendant des années, la stratégie SEO dominante consistait à produire du contenu « suffisamment bon » sur un maximum de mots-clés. L'IA générative a rendu cette approche obsolète. Si n'importe qui peut produire un article de 1500 mots sur n'importe quel sujet en 30 secondes, la compétition se déplace ailleurs.

Chez AISOS, nous observons que les entreprises qui maintiennent leur visibilité sont celles qui ont investi dans des éléments impossibles à répliquer par l'IA : données propriétaires, études de cas clients documentées, points de vue tranchés assumés par des experts identifiables.

L'E-E-A-T devient non négociable

Le framework E-E-A-T de Google (Expérience, Expertise, Autorité, Fiabilité) n'est plus un bonus : c'est le filtre principal. Les critères concrets incluent :

- Expérience : preuves que l'auteur a une pratique directe du sujet (études de cas, témoignages vérifiables)

- Expertise : credentials vérifiables, publications dans le domaine, reconnaissance par les pairs

- Autorité : citations par d'autres sources fiables, backlinks qualitatifs

- Fiabilité : transparence sur l'identité de l'entreprise, mentions légales, politique éditoriale claire

GEO et IA génératives : un nouveau champ de bataille

Le SEO traditionnel concerne Google. Mais en 2025, une part croissante des recherches informationnelles passe par ChatGPT, Perplexity, Google AI Overview et Gemini. Ces systèmes ont leurs propres critères de sélection des sources, et la pollution de l'Internet les affecte différemment.

Comment les LLM sélectionnent leurs sources

Les modèles de langage comme GPT-4 ou Claude ne fonctionnent pas comme les moteurs de recherche traditionnels. Leur sélection de sources repose sur :

- La cohérence avec le corpus d'entraînement : les sources citées régulièrement dans des contextes fiables sont privilégiées

- La clarté des entités : les LLM comprennent mieux les contenus où les entreprises, personnes et concepts sont explicitement nommés et décrits

- L'actualité vérifiable : pour les requêtes récentes, les systèmes RAG (Retrieval-Augmented Generation) privilégient les sources datées et sourcées

- La structure logique : les contenus organisés en sections autonomes et cohérentes sont plus facilement extraits et cités

Le risque de dilution dans le bruit

Si l'Internet se remplit de contenus IA qui paraphrasent les mêmes informations, les LLM auront du mal à identifier les sources originales. Une entreprise qui produit une étude originale risque de voir ses conclusions reprises par des centaines de sites générés, au point que le LLM ne sache plus attribuer l'information à sa source.

Ce phénomène de « blanchiment de l'information » est déjà observable. Des PME innovantes voient leurs insights repris sans attribution par des sites de contenu automatisé, puis cités par les IA comme provenant de sources génériques.

Perplexity et la prime à la source primaire

Perplexity AI se distingue par son système de citation explicite. Chaque réponse inclut les sources utilisées. Ce modèle valorise les contenus qui se positionnent comme sources primaires : études originales, données exclusives, témoignages directs. Les agrégateurs de contenu sont systématiquement déclassés au profit des producteurs d'information originale.

Solutions concrètes : se démarquer dans un Internet saturé

Face à ce contexte, les dirigeants d'entreprise doivent repenser leur stratégie de contenu. Voici les leviers actionnables identifiés par les praticiens du GEO.

Investir dans les contenus « impossibles à générer »

L'IA générative excelle dans la synthèse et la reformulation. Elle échoue sur ce qui requiert un accès au monde réel :

- Études de cas clients détaillées avec chiffres vérifiables, noms d'entreprises, contexte spécifique

- Données propriétaires issues de votre activité (benchmarks sectoriels, analyses de portefeuille, tendances observées)

- Interviews et témoignages de collaborateurs, clients, partenaires identifiables

- Retours d'expérience projet avec méthodologie, obstacles rencontrés, résultats mesurés

Ces contenus sont coûteux à produire mais impossibles à répliquer. Ils deviennent des actifs stratégiques durables.

Structurer pour les LLM : le format « citation-ready »

Pour maximiser vos chances d'être cité par ChatGPT, Perplexity ou Gemini, adoptez une structure qui facilite l'extraction :

- Chaque section doit être auto-suffisante : compréhensible sans lire le reste de l'article

- Les affirmations clés doivent être explicites : « Le taux de conversion moyen en B2B industriel est de 2,3% » plutôt que des formulations vagues

- Les entités doivent être nommées clairement : « AISOS, agence spécialisée en GEO basée à Paris » plutôt que « notre entreprise »

- Les sources et dates doivent être mentionnées : les LLM privilégient les informations datées et attribuables

Renforcer l'identité d'entité de votre marque

Les moteurs de recherche et les LLM s'appuient sur les « knowledge graphs » pour comprendre les relations entre entités. Une entreprise bien représentée dans ces graphes sera plus facilement identifiée comme source fiable.

Actions concrètes :

- Créer ou enrichir votre fiche Wikidata avec des informations vérifiables

- Assurer la cohérence des informations sur tous vos profils (LinkedIn entreprise, Crunchbase, annuaires sectoriels)

- Obtenir des mentions dans des sources tierces fiables (presse spécialisée, études sectorielles, publications académiques)

- Implémenter le balisage Schema.org sur votre site (Organization, Person, Article, FAQ)

Développer une stratégie de « thought leadership » documenté

Les dirigeants et experts de votre entreprise sont des atouts sous-exploités. Un point de vue original, documenté et assumé par une personne identifiable a plus de valeur qu'un article générique de marque.

- Publiez des analyses signées par vos experts sur LinkedIn et votre blog

- Participez à des podcasts et webinaires sectoriels où vos insights seront cités

- Rédigez des tribunes dans la presse spécialisée de votre secteur

- Documentez vos prises de position sur les évolutions de votre marché

Checklist opérationnelle pour 2025-2026

Voici une synthèse des actions prioritaires pour adapter votre stratégie de visibilité au contexte d'un Internet saturé de contenus générés.

Audit immédiat (Q1 2025)

- Analyser la part de votre trafic organique provenant de requêtes informationnelles vs transactionnelles

- Identifier vos contenus les plus cités par les LLM (outils comme Perplexity pour tester vos requêtes cibles)

- Évaluer votre présence dans les knowledge graphs (recherche Google de votre marque, vérification Wikidata)

- Auditer la structure de vos contenus existants pour la compatibilité LLM

Stratégie de contenu (Q2-Q3 2025)

- Réduire le volume de contenus génériques au profit de contenus à forte valeur ajoutée

- Lancer un programme de documentation d'études de cas clients

- Créer un calendrier de publications « thought leadership » pour vos experts

- Développer des contenus basés sur vos données propriétaires

Optimisation technique (continu)

- Implémenter le balisage Schema.org sur l'ensemble du site

- Assurer la cohérence des informations d'entité sur tous les canaux

- Optimiser la structure des articles pour l'extraction par LLM

- Mettre en place un monitoring de vos citations dans les réponses IA

Conclusion : l'authenticité comme avantage concurrentiel

Les craintes de Sam Altman sur la Dead Internet Theory ne sont pas une dystopie lointaine. Elles décrivent une évolution déjà en cours qui impacte la visibilité des entreprises. Mais cette évolution crée aussi une opportunité pour les organisations qui investissent dans l'authenticité.

Dans un Internet saturé de contenus générés, les signaux d'expertise réelle, d'expérience documentée et d'entité vérifiable deviennent des différenciateurs puissants. Les entreprises qui adoptent ces pratiques maintenant construisent un avantage durable.

Les audits AISOS révèlent que les PME et ETI ont souvent des actifs sous-exploités : données clients, retours d'expérience, expertise sectorielle. Transformer ces actifs en contenus structurés pour le SEO et le GEO est le chantier prioritaire des 18 prochains mois.

La question n'est plus de produire plus de contenu. Elle est de produire du contenu que ni l'IA ni vos concurrents ne peuvent répliquer. C'est là que se joue votre visibilité dans l'Internet de demain.

Articles similaires

AI Overview et requêtes commerciales : Pourquoi votre tracking SEO vous trompe

Google AI Overviews : pourquoi les requêtes commerciales affichent moins d'entreprises (et comment réagir)

Preferred Sources dans Google AI Overviews : comment être sélectionné comme source privilégiée